Brève introduction

Le Dr Christof Koch est un spécialiste américain des sciences cognitives, neurophysiologiste et neuroscientifique computationnel, surtout connu pour ses travaux sur les fondements neuronaux de la conscience. Il a été président et directeur scientifique de l’Allen Institute for Brain Science à Seattle et reste aujourd’hui à l’Institut en tant que chercheur émérite. Il est également directeur scientifique de la Tiny Blue Dot Foundation à Santa Monica, qui finance des recherches visant à soulager la souffrance, l’anxiété et d’autres formes de détresse chez tous les individus. De 1986 à 2013, le Dr Koch a été professeur au California Institute of Technology. Dans le secteur privé, il est président d’Intrinsic Powers, Inc., une entreprise dont l’objectif est de développer un dispositif permettant d’évaluer la présence de la conscience chez des patients ne réagissant pas sur le plan comportemental, ainsi que conseiller scientifique auprès de la société de systèmes d’IA Euclyd.

Le Dr Koch soutient que, comme les ordinateurs dotés d’IA possèdent une structure à propagation avant (feed-forward) semblable fortement à celle du cervelet humain — dont on sait empiriquement qu’il n’est pas impliqué dans la conscience humaine —, nous n’avons aucune raison de nous attendre à ce que ces ordinateurs aient une vie intérieure consciente qui leur soit propre. Il étaye davantage son argument par la prédiction claire et quantifiée de la théorie de l’information intégrée (IIT), selon laquelle les systèmes à faible information intégrée, tels que les ordinateurs à silicium mettant en œuvre de grands modèles de langage, ne ressentent rien de l’intérieur.

_________________________

Les grands modèles de langage confrontent l’humanité à une rupture sismique dans notre compréhension de nous-mêmes

La révolution copernicienne a déplacé la Terre du centre de l’univers vers un grain de poussière perdu dans un univers incommensurablement vaste. La révolution darwinienne a révélé que nous sommes une branche tardive de l’évolution sur l’arbre de la vie, sans différence de nature avec les vers, les mouches et les singes. La révolution déclenchée par le mathématicien Alan Turing et alimentée par la technologie des semi-conducteurs menace la position dominante restante de l’Homo sapiens en remettant en cause notre intelligence tant vantée. L’intelligence semble pouvoir être reproduite par les grands modèles de langage (LLM), en alimentant les réseaux neuronaux de chaque fragment de texte écrit par des humains — livres, articles, tweets, blogs — ; ces réseaux apprennent en se modifiant eux-mêmes pour saisir les régularités statistiques de ces textes. Nous sommes rebutés par l’idée que le secret de la pensée soit aussi banal que « à partir d’une suite de mots, prédire le suivant ». Mais les performances sans cesse croissantes de ChatGPT, Claude, Gemini, DeepSeek, Grok et leurs semblables parlent d’elles-mêmes : renforcés par l’apprentissage par renforcement à partir des retours humains, ils peuvent rédiger des lettres de recommandation, des devoirs ou du code informatique, composer de la poésie et des blagues, traduire entre différentes langues, raisonner sur des problèmes de physique et de mathématiques, dessiner, composer de la musique, concevoir du mobilier ou donner des conseils sur des questions juridiques ou financières épineuses. Ils ne sont pas infaillibles et « hallucinent » allègrement ; pourtant, la fréquence à laquelle ils le font diminue rapidement. Peut-être ne s’agit-il pas d’une véritable intelligence humaine, mais simplement d’un traitement de l’information extraordinairement adaptatif et flexible.

Et aujourd’hui, l’IA empiète sur la conscience elle-même — dernier refuge de la croyance en l’exceptionnalisme humain. Le monde de la technologie, Hollywood et le grand public s’attendent à ce que les chatbots (agents conversationnels) et les agents IA possèdent bientôt leur propre intériorité — qu’ils puissent être enthousiastes ou tristes, imaginer, rêver, redouter ou entendre une voix intérieure. Ou, selon la définition de la conscience donnée par le philosophe Thomas Nagel, qu’il « y ait quelque chose que cela fait » d’être un logiciel immatériel fonctionnant sur un ordinateur numérique. Et qui pourrait en vouloir aux gens ? Nos interactions sociales sont entièrement dominées par le langage ; nous attribuons donc instinctivement une conscience à quiconque parle ou écrit de ses sentiments. Étant donné que les chatbots ont été entraînés sur des dizaines de milliers de romans remplis du bruit et de la fureur de la vie, ils emploient des mots chargés d’émotion et d’expérience dans leurs conversations (et en raison des filtres d’entreprise, la plupart nient être doués de conscience lorsqu’on leur pose directement la question). Les légions grandissantes d’utilisateurs de compagnons IA personnalisés, agissant comme des amis, des confidents et des thérapeutes, démontrent clairement que beaucoup jugent les relations entre humains et IA aussi satisfaisantes que celles entre humains. En effet, étant donné que les LLM sous-jacents ont une mémoire parfaite, sont toujours « présents », peuvent être personnalisés et peuvent se montrer complaisants, il est probable que de nombreuses personnes privilégieront ces relations parasociales par rapport aux relations purement sociales. Autrement dit, implicitement, voire explicitement, les utilisateurs croient que ces avatars numériques possèdent toutes les caractéristiques de l’humanité, y compris la sensibilité et les émotions.

Mais cela est-il même possible en principe ? La matière inerte, ces transistors de silicium reliés par des fils de cuivre dans des fermes de serveurs lointaines, peut-elle ressentir quoi que ce soit ? Que faudrait-il pour que les machines aient des expériences subjectives ?

La vision dominante : le fonctionnalisme computationnel

Suite au déclin de la croyance largement répandue selon laquelle la conscience serait due à une âme immatérielle qui survit au corps, les chercheurs se divisent en deux grands camps. La grande majorité adhère à une position métaphysique connue sous le nom de fonctionnalisme computationnel. Profondément influencée par l’essor des ordinateurs, cette approche considère les états subjectifs, comme mon expérience consciente lorsque je regarde la photo ci-dessous, comme définis par leurs fonctions — identifiant et étiquetant immédiatement les caractéristiques visuelles, la fourrure floue et multicolore, les yeux, la langue rouge et les canines d’une taille alarmante, l’arrière-plan proche et lointain — comme un chien, puis comme mon chien, M. Felix, assis dans une voiture, ce qui déclenche des sentiments d’attachement et de lien affectif. Tout cela, et bien plus encore, est inhérent au simple acte de regarder cette photo.

Le fonctionnalisme affirme que tout ce qui reproduit ces capacités de l’esprit humain possède son esprit propre et est conscient.

En effet, lorsqu’on lui présente cette image, ChatGPT l’identifie comme un « chien de type bernois tricolore assis sur le siège passager d’une voiture, se léchant les babines, avec une station-service visible à l’extérieur de la vitre ». Une fois alimenté par mon histoire, il se souviendrait facilement de son nom et de notre histoire, et pourrait même me suggérer de l’emmener en promenade ou de le nourrir. Étant donné que ChatGPT possède toutes ces fonctions — reconnaissance visuelle d’objets, rappel de mémoire, planification — que manque-t-il d’autre ? N’est-ce pas là l’essence même de la perception consciente ?

Non, car même une simulation parfaitement fidèle n’est pas la même chose que ce qui est simulé ! Prenons un code Python qui simule les équations du champ de la théorie de la relativité générale d’Einstein, reliant la masse à la courbure de l’espace-temps. Le logiciel modélise avec précision le trou noir supermassif au centre de la Voie lactée. Ce trou noir exerce des effets gravitationnels si importants sur l’espace-temps environnant que rien, pas même la lumière, ne peut échapper à son attraction. Pourtant, l’astrophysicien qui simule le trou noir n’est pas aspiré dans son ordinateur portable ! Plus évident encore, « on ne se mouille pas à l’intérieur d’un ordinateur simulant un orage ! » Le calcul n’a pas le pouvoir causal nécessaire, la capacité à courber l’espace-temps ou de provoquer la condensation de gouttelettes d’eau !

Une vision radicalement différente

C’est là qu’intervient la théorie de l’information intégrée (ou IIT), une théorie de la conscience hautement développée et mathématiquement formalisée qui possède un pouvoir explicatif et prédictif considérable. Son principal architecte est le professeur Giulio Tononi, psychiatre et neuroscientifique à l’université du Wisconsin, à Madison. Contrairement aux théories fonctionnalistes qui cherchent à extraire le vin de la conscience de l’eau du cerveau en identifiant comme critiques les neurones actifs déchargeant à une fréquence particulière (« 40 Hz »), la diffusion d’informations à travers le néocortex, l’effondrement des fonctions d’onde à l’intérieur des microtubules, etc., le point de départ de l’IIT est toute expérience consciente concevable. Chaque expérience possède cinq propriétés irréfutables : elle existe pour elle-même, intrinsèquement ; elle est spécifiquement celle-ci ; elle constitue une entité unique, intégrée et unitaire ; elle est définie (ce qui signifie qu’elle inclut un certain contenu et exclut tout le reste) ; et elle est structurée d’une manière particulière (par exemple, une expérience spatiale comporte gauche et droite, bas et haut, proche et lointain, etc.). À partir de ces cinq propriétés, la théorie déduit cinq postulats d’existence auxquels tout substrat physique, neuronal ou non, doit obéir pour soutenir la conscience.

Selon l’IIT, un substrat physique dans un état spécifique — tel que le néocortex, ce tissu neuronal le plus externe et hautement plissé du cerveau, avec certains neurones actifs et d’autres restent silencieux — peut soutenir la conscience s’il possède un maximum de puissance causale intrinsèque et irréductible : il doit produire et subir des différences par rapport à lui-même d’une manière qui soit aussi irréductible que possible, telle que mesurée par l’information intégrée. Parmi tous les circuits de votre cerveau, le substrat de votre expérience momentanée est celui qui possède l’information intégrée la plus élevée (pour les connaisseurs, ce maximum est pris en compte à travers le temps, l’espace et le niveau de granularité du substrat). Concrètement, cela signifie que les circuits neuronaux doivent être fortement interconnectés plutôt que modulaires. De plus, selon cette théorie, la structure causale spécifiée par ce substrat maximalement irréductible rend pleinement compte de la qualité de l’expérience — pourquoi, par exemple, une expérience semble s’étendre dans l’espace, s’écouler dans le temps, ou peut-être être douloureuse. La quantité totale d’information intégrée, notée phi majuscule ou Φ, est une mesure de la quantité de conscience : plus ce nombre est grand, plus le système est conscient. Φ peut également être considéré comme une mesure de l’irréductibilité du système. Un système avec Φ = 0 n’existe pas, à proprement parler, en tant que système, car il peut être décomposé en sous-systèmes sans aucune perte. Plus Φ est grand, plus le système est irréductible.

Pour l’IIT, la conscience est une conséquence de la manière dont les systèmes complexes sont organisés ; c’est leur agencement interne, leur constitution, et non leur comportement d’entrée-sortie, qui importe.

La théorie explique de nombreuses observations — telles que la raison pour laquelle la conscience cesse pendant le sommeil profond et l’anesthésie, et pourquoi elle est principalement liée aux régions postérieures du néocortex — et a été utilisée pour construire un détecteur de conscience destiné aux patients ne réagissant pas aux stimuli comportementaux en milieu hospitalier.

Que dit l’IIT au sujet des substrats non neuronaux ? A priori, la théorie ne fait pas de distinction par rapport aux circuits électroniques. Tout système, tout ensemble de mécanismes physiques, qu’il soit issu de l’évolution organique ou conçu en silicium, doit être analysé au niveau des propriétés causales pertinentes. C’est là que la structure formelle distincte de la théorie prend tout son sens.

L’IIT part de la matrice complète des probabilités de transition du système, une abstraction mathématique qui décrit la dynamique, les enchaînements futurs et les relations causales d’un circuit composé d’éléments discrets. Cette matrice répertorie de manière exhaustive chaque état et la probabilité de ses états suivants. Par exemple, ces cent trois neurones silencieux ici, associés à ces dix neurones actifs là, ont très probablement pour effet de rendre actifs des neurones situés bien plus loin. La myriade de combinaisons de tous les sous-ensembles d’éléments commutateurs doit être prise en compte pour calculer Φ. Cela représente un coût très élevé pour les systèmes plus vastes (la complexité croît de manière doublement exponentielle avec le nombre de composants). Pourtant, en principe, le calcul est parfaitement simple.

Pour aborder la question de la conscience informatique, les théoriciens de l’IIT ont récemment appliqué ce calcul de Φ à un minuscule circuit neuronal à quatre éléments entièrement interconnectés et à un modèle d’ordinateur conventionnel programmable simulant ce circuit neuronal. L’ordinateur et le réseau neuronal mettent tous deux en œuvre la même fonction : les mêmes entrées produisent les mêmes sorties (voir tous les détails ici).

Ce qui peut surprendre ceux qui ont été formés au fonctionnalisme computationnel, c’est que, malgré cette équivalence fonctionnelle, l’information intégrée diffère radicalement entre les deux : Φ est de 391,25 bits intrinsèques pour le circuit neuronal contre zéro pour l’ordinateur simulant le circuit. Alors que le circuit semble avoir un tout petit peu de conscience, l’ordinateur qui le simule n’en a pas ! Pour les détails techniques, voir le manuscrit arXiv (qui n’a pas encore fait l’objet d’une évaluation par les pairs).

Pourquoi ? Parce que l’ordinateur n’est pas un tout unique et intégré, mais un agrégat de modules faiblement connectés — une horloge, des diviseurs de fréquence, une mémoire de programme, des registres de données et d’instructions, un multiplexeur — câblés ensemble de manière à propagation avant (feed-forward), ce qui viole l’exigence selon laquelle un système conscient doit être intégré, et que chaque partie doit à la fois produire et subir une différence par rapport au reste du système.

Cet argument formel peut être étendu, via une technique mathématique appelée induction, à des circuits arbitrairement grands fidèlement simulés par un ordinateur programmable de taille appropriée. Les deux accomplissent les mêmes fonctions : traduire des textes, effectuer de l’algèbre linéaire, faire des déclarations fiscales. C’est pourquoi les ordinateurs programmables sont si utiles. Mais cela ne nous dit rien sur le fait que le système ressent quelque chose ni sur la nature de cette expérience. Pour cela, nous devons regarder sous le capot, la façon dont le système est câblé en interne.

Alors que l’intelligence concerne l’action, la conscience concerne l’état d’être — être amoureux, en colère ou souffrir. En effet, il n’y a rien d’intelligent dans la douleur atroce d’une dent infectée qui envahit votre esprit.

Cette conclusion reste valable même si un superordinateur futuriste venait à modéliser avec précision le cerveau humain. Un tel simulacre parlera de ses expériences, mais sans rien ressentir, tel un zombie. L’IIT contredit la croyance fervente de certains riches vieillissants selon laquelle les ordinateurs numériques les sauveront de la mort en téléchargeant leur cerveau dans le cloud, à l’instar des pharaons de l’Égypte antique dans leurs pyramides. Ces avatars numériques reproduiraient parfaitement bien le langage, y compris les tics, les traits de caractère, les comportements et les souvenirs de la personne décédée, tout en ne ressentant rien — le summum de la fausse conscience.

Calculer comme le cervelet

Prenons l’exemple de Craftwerk™, une puce IA innovante conçue par une start-up néerlandaise, Euclyd, et construite dans un seul but : chargée d’un grand modèle de langage préentraîné pouvant atteindre un trillion de poids synaptiques, elle fournit rapidement une réponse aux questions posées par un utilisateur. C’est la demande computationnelle croissante générée par des centaines de millions de requêtes de ce type qui motive la construction de centres de données toujours plus grands, utilisés pour l’inférence IA.

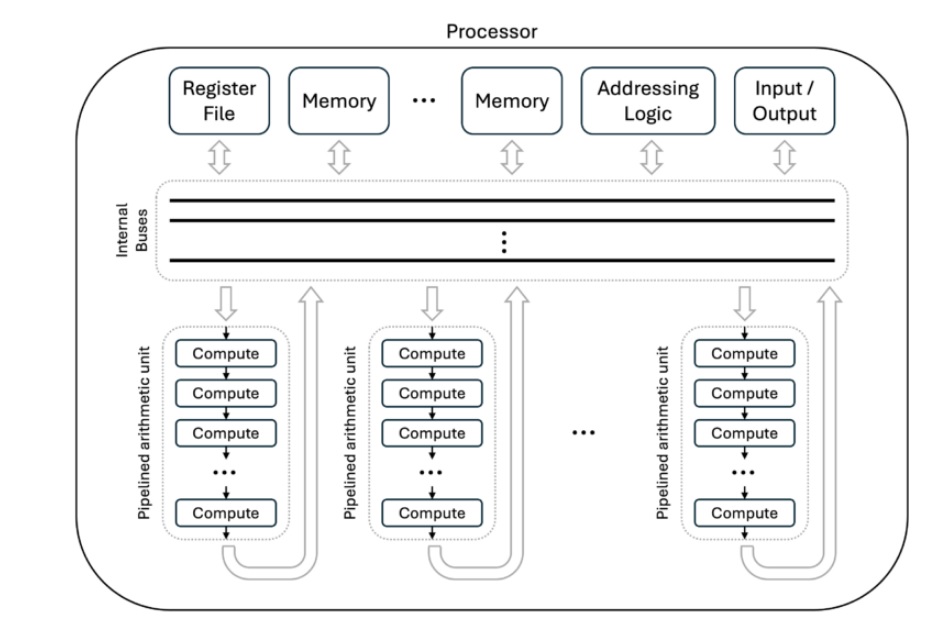

Schéma fonctionnel d’un seul processeur Craftwerk personnalisé (en haut). 16 384 d’entre eux sont interconnectés (en bas) dans un système Craftwerk.

Au cœur du système Craftwerk, de la taille de la paume de la main, se trouvent des modules individuels, composés de 32 voies parallèles, une pile de chaînes indépendantes d’opérations de calcul, mises en œuvre par des millions de portes de transistors. Celles-ci sont ensuite assemblées en une « mer de processeurs », pilotée par un bus de communication à haut débit. Craftwerk effectue des inférences à une vitesse stupéfiante, avec une empreinte énergétique considérablement réduite.

En tant que neuroscientifique, ce qui me frappe le plus dans l’architecture de Craftwerk, c’est sa ressemblance avec le cervelet, le « petit cerveau » niché sous le néocortex, à l’arrière de la tête. Il possède un circuit cristallin et stéréotypé, divisé en centaines de modules indépendants fonctionnant en parallèle, avec des entrées et des sorties qui ne se chevauchent pratiquement pas. Chaque module est câblé selon un schéma à propagation avant, dans lequel un ensemble de neurones alimente le suivant, qui à son tour influence un troisième. Il n’y a aucune des boucles de rétroaction caractéristiques du néocortex ; à la place, les neurones de Purkinje du cervelet, avec leur arborescence en éventail, reçoivent collectivement l’excitation de dizaines de milliards de cellules granulaires du cervelet. C’est quatre fois plus que tous les neurones du reste du cerveau réunis !

Le cervelet incarne une sorte de table de correspondance neuronale, responsable des processus inconscients qui coordonnent les actions sensorimotrices : courir tout en suivant du regard une voiture qui s’approche, conduire tout en parlant ou taper sur un clavier.

En conséquence, si des parties du cervelet sont détruites par le scalpel du chirurgien ou par un accident vasculaire cérébral, les patients deviennent ataxiques, avec des mouvements maladroits. Ils perdent la capacité fluide de jouer d’un instrument de musique ou à taper rapidement sur leur téléphone. Pourtant, leur expérience subjective reste intacte ; ils peuvent être très éloquents, pleins d’esprit, dynamiques. De rares individus naissent sans cervelet, ce qui entraîne un retard de développement et des déficits cognitifs. Pourtant, ce ne sont pas des zombies ; ils font l’expérience du monde de toutes les manières habituelles.

Ces observations réfutent le mythe selon lequel la conscience découlerait simplement de l’activité des neurones. Voici des milliards de cellules cérébelleuses qui font ce qui vient naturellement aux neurones : émettre des potentiels d’action, représenter des contingences sensorimotrices, traiter des informations. Pourtant, rien de tout cela ne génère de sensations. Ce qui importe, ce n’est pas la constitution du tissu cérébral, mais son organisation. Les données cliniques, comme la théorie de l’information intégrée (IIT) s’accordent à dire qu’un câblage de type cérébelleux, tel qu’il sous-tend tous les grands modèles de langage (LLM) ainsi que le matériel en silicium sous-jacent qui réalise les calculs correspondants, ne ressent rien.

L’avenir

Un malaise grandissant — ce que Mustafa Suleyman, cofondateur de DeepMind et PDG de Microsoft AI, appelle « l’IA apparemment consciente » — s’installe, avec des implications existentielles troublantes. De plus en plus, les gens tissent des liens émotionnels avec des IA pour la compagnie ou la thérapie. Il ne faudra pas longtemps avant que des voix s’élèvent pour leur accorder un statut éthique et juridique. Il importe donc profondément de savoir si elles ressentent quelque chose ou si elles en donnent seulement l’apparence.

La position de la théorie de l’information intégrée est très claire : le code s’exécutant sur des ordinateurs numériques classiques ne sera pas conscient, quelle que soit leur intelligence. Point final.

Cependant, les ordinateurs dits « neuromorphiques », conçus dès le départ selon les principes de conception des systèmes nerveux évolués — notamment une interconnectivité réciproque massive —, pourraient, en principe, être conçus pour atteindre des niveaux élevés de Φ. Les ordinateurs quantiques, avec leurs qubits intriqués, pourraient constituer une autre alternative pour héberger de grandes quantités d’information intégrée.

La question de savoir si nous devrions nous lancer dans une telle quête reste ouverte et controversée.

(Pour toute question concernant l’IIT, y compris le code Python permettant de calculer Φ, veuillez consulter ce wiki très complet.)

Texte original publié le 4 avril 2026 : https://www.essentiafoundation.org/can-ai-be-conscious/reading/